资讯提供:图文资通组

文章来源及发佈日:

https://technews.tw/2017/08/31/google-explains-how-artificial-intelligence-becomes-biased-against-women-and-minorities/

雷锋网 2017年08月31日14:12 | 分类 AI 人工智慧

透过研究显示,人类研发的机器也能学到人类看世界的观点,无论是否有意。对阅读文本的人工智慧来说,它可能会将「医生」一词与男性优先关联,而非女性,或影像辨识也会更大机率将黑人错误分类为大猩猩。

2015 年,Google Photos 应用误把两名黑人标註为「大猩猩」,当时这错误意味着 Google 的机器学习还处于「路漫漫其修远兮」的状态。Google 立即对此道歉,并表示将调整演算法,以修復该问题。近日,身为错误的责任方,Google 正在尝试让大众了解 AI 如何不经意间永久学到创造它们的人持有的偏见;一方面,这是 Google 对外 PR(公关)的好方式,其次,AI 工程师也可用一种简单的方法来简介自己的偏见演算法。

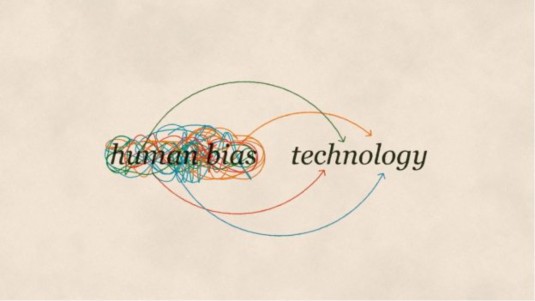

在影片中,Google 介绍了 3 种偏见:

互动偏差:用户可透过我们与其互动的方式来偏移演算法。例如,Google 召集一些参与者,让他们每人画一只鞋,但多半用户会选择画男鞋,故以这些资料为基础的系统可能不会知道高跟鞋也是鞋子。

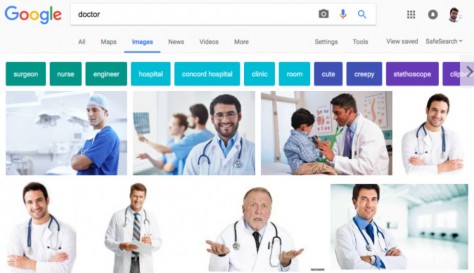

潜在偏差:该演算法会将想法和性别、种族、收入等不正确地联繫。例如,当用户在 Google Search 搜寻「医生」时,出现的大多为白人男性。

之前 Quarts 发了一则相关新闻,该报导称,经普林斯顿大学最新研究成果,这些偏见,如将医生与男性相关联,将护士与女性关联,都来自演算法被教授的语言影响。正如一些资料科学家所说:没有好的资料,演算法也做不出好决策。

选择偏差:据了解,用于训练演算法的资料量已大大超过全球人口,如果训练影像辨识的资料仅针对白人进行,那么得到的资料也只能来自 AI 有限的认定。

(Source:Qaurtz)

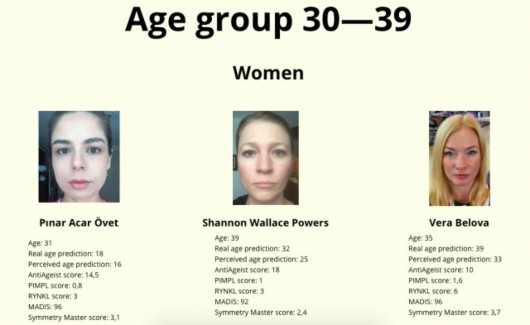

去年 6 月,「青年实验室」(辉达、微软等科技巨擘均是该实验室的合作伙伴和支援者)举办了一次 Beauty.ai 网路选美大赛。比赛透过人工智慧分析,徵集了 60 万条纪录。演算法参考皱纹、脸部比例、皮肤疙瘩和瑕疵的数量、种族和预测的年龄等因素。最后结果显示,种族因素比预期发挥更大的作用:在 44 名获奖者中,其中有 36 人为白人。

事实上,关于演算法中含有性别、种族偏见的研究和报导,早已有之。据之前报导,要消除这些偏见,并不容易。正如微软纽约研究院的进阶研究员 Hanna Wallach 所说:

只要机器学习的程式是透过社会已存在的资料训练,那么只要这个社会有偏见,机器学习就会重现这些偏见。

•Google explains how artificial intelligence becomes biased against women and minorities